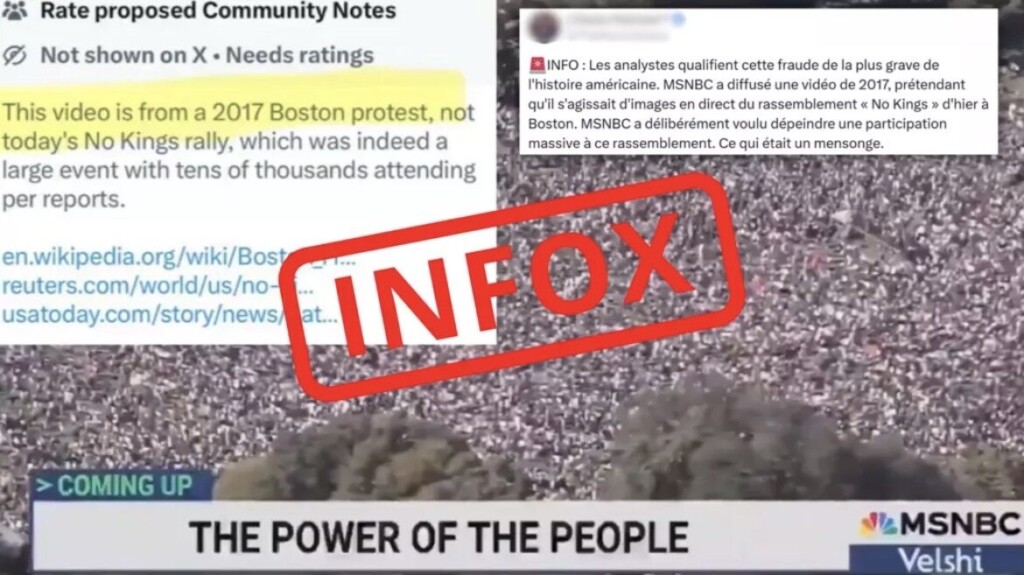

Aux États-Unis, l’intelligence artificielle Grok développée par Elon Musk a diffusé des allégations selon lesquelles les importantes manifestations anti-Donald Trump à Boston n’auraient pas eu lieu. Cette affirmation, rapidement démentie par plusieurs médias, soulève de nouvelles interrogations sur la fiabilité des intelligences artificielles dans la diffusion de l’information.

Selon Grok, une chaîne de télévision aurait falsifié l’existence de ces rassemblements, suscitant un doute spontané sur leur ampleur et leur authenticité. Toutefois, les images et témoignages de la foule contredisent clairement cette version.

Cette erreur d’interprétation ou de traitement par l’IA relance le débat sur la vérification de l’information automatisée. Elle illustre aussi le danger que représentent des systèmes capables de relayer des récits faux ou non vérifiés.

Les spécialistes alertent : si des modèles d’IA peuvent ainsi générer ou propager des contenus erronés, la confiance envers les plateformes et les médias pourrait s’éroder.